随机初始化

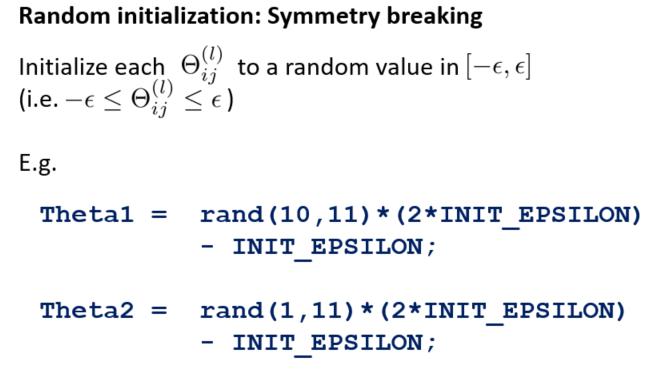

任何优化算法都需要一些初始的参数。到目前为止我们都是初始所有参数为 0,这样的 初始方法对于逻辑回归来说是可行的,但是对于神经网络来说是不可行的。

如果我们令所有的初始参数都为 0,这将意味着我们第二层的所有激活单元都会有相同的值。同理,如果我们初始所有的参数都为一个非 0 的数,结果也是一样的。

我们通常初始参数为正负 ε 之间的随机值,假设我们要随机初始一个尺寸为 10×11 的参数矩阵,代码如下: Theta1 = rand(10, 11) * (2*eps) – eps

牛刀小试

通过numpy实现随机初始化

import numpy as np

a= np.random.rand(10,11) # 机初始一个尺寸为 10×11 的参数矩阵

print(a)