特征与多项式回归

- 多项式回归

在房价预测问题中, 假设我们的特征数据为$x_1=frontage(临街宽度)$,$x_2=depth(纵向深度)$。

线性回归建模为:

但是我们可以自己创建一个特征 $x = Area(面积) = frontage \times depth$

再进行建模: 效果会好很多。

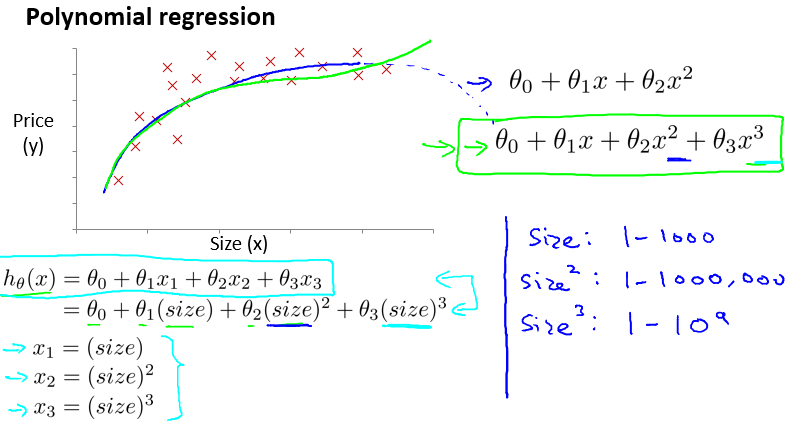

线性回归并不适用于所有数据,有时我们需要曲线来适应我们的数据,比如一个二次方模型: 或者三次方模型:

通常我们需要先观察数据然后再决定准备尝试怎样的模型。 另外,我们可以令: 从而将模型转化为线性回归模型。

根据函数图形特性,我们还可以使用: 或者:

注:如果我们采用多项式回归模型,在运行梯度下降算法前,特征缩放非常有必要。因为幂运算很容易拉大特征之间尺度的差距

牛刀小试

Todo: 观察二次方模型和三次方模型拟合曲线的差异,思考,n 次方模型的 n 越大越好吗?

答:不是的, 合理的选择 n 非常重要。